| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | ||||||

| 2 | 3 | 4 | 5 | 6 | 7 | 8 |

| 9 | 10 | 11 | 12 | 13 | 14 | 15 |

| 16 | 17 | 18 | 19 | 20 | 21 | 22 |

| 23 | 24 | 25 | 26 | 27 | 28 | 29 |

| 30 | 31 |

- Limit

- not in

- airflow.cfg

- matplotlib

- 머신러닝

- SUM

- 전처리

- hackerrank

- 데이터분석

- TRUNCATE

- PostgreSQL

- SQLite

- 프로그래머스

- airflow 설치

- SQL

- 그로스해킹

- solvesql

- having

- Oracle

- 다중 JOIN

- GROUPBY

- 데이터시각화

- 결측값

- join

- 데이터리안 웨비나

- Round

- MySQL

- 파이썬

- pandas

- seaborn

- Today

- Total

목록DevOps (14)

Milky's note

[GCP] Google Cloud SDK로 SSH 터널링 (로컬 cmd에서 서버 접속)

[GCP] Google Cloud SDK로 SSH 터널링 (로컬 cmd에서 서버 접속)

내가 현재 진행하고 있는 프로젝트는 GCP 기반으로 폐쇄망을 사용한다.추가로 Public IP도 사용하지 않고 GCP 내부 IP만 사용한다. 초반에 Airflow를 Public IP로 구성을 해놓았는데 내부 IP만 허용이 되는 정책으로 변경이 되었다...어쩔 수 없이 Airflow 서버를 내부 IP만 사용되게 하였는데 당연하게도 Airflow UI 접속이 불가능해졌다 ! 그래서 내가 생각한 방법은 로컬에서 서버로 접속하기 ! 내부 IP만 사용하지만 SSH 터널링을 사용하면 서버로 접속이 가능하다 ! 1. 로컬에 SSH 연결 외부 IP 없이 Airflow UI에 접속하기 위해 SSH 터널링을 사용할 수 있다.이 방법은 로컬에서 GCP의 VM 인스턴스에 SSH로 연결한 후,Airflow UI에 접근할 수 ..

[Airflow] Gmail로 alert 메일 보내기(Email Operator 설정)

[Airflow] Gmail로 alert 메일 보내기(Email Operator 설정)

Airflow Dag들이 실패하면 메일로 alert를 받아볼 수 있게 Email Operator를 설정해주려고 한다! 먼저 mail을 보낼 gmail 계정이 있어야 하기 때문에없다면 먼저 google에 가입을 해준다. 1. Gmail의 IMAP 활성화이제 구글에 로그인을 해서 IMAP를 켜줘야한다! [Gmail] -> [설정] -> 모든 설정 보기 클릭! [전달 및 POP/IMAP] -> [IMAP 액세스]에서 IMAP 사용을 체크 !! 2. SMTP 비밀번호 설정이제 airflow config 파일에 넣어줄 smtp 비밀번호를 설정해준다.smtp 비밀번호를 생성하기 위해선 먼저 2단계 인증이 설정되어야 한다. 그리고 앱 비밀번호를 만들어준다.앱 비밀번호가 잘 안보였었는데 위에 검색창에서 검색했다...

[GCP] 랜딩존 설정으로 차단된 Google API 호출 (GA, GSC, Google Ads, Youtube)

[GCP] 랜딩존 설정으로 차단된 Google API 호출 (GA, GSC, Google Ads, Youtube)

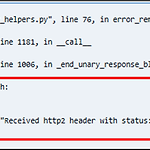

GCP 프로젝트가 랜딩존으로 들어가면서 네트워크 구성이 바뀌었다. 기존 내가 생성한 VPC에서 조직 범위에서 생성한 VPC가 공유되었고,공유된 VPC를 써서 Google 소유의 API들 호출이 오류가 발생했다.GA, GSC, Google Ads, Youtube 등... 발생한 오류는 다음과 같았다.google.api_core.exceptions.permissiondenied: 403 received http2 header with status: 403 랜딩존 설정으로 인하여 API 주소를 찾지 못하고 있다.해결 방법으로는 hosts 파일에 API를 직접 하나씩 등록해주어야 한다. sudo vi/etc/hosts hosts 파일은 root로 수정해야한다 ! 그리고 아래와 같이 사용하는 API들을 넣어준..

[Airflow] GCP 내부 IP로 Airflow UI 접속하기

[Airflow] GCP 내부 IP로 Airflow UI 접속하기

GCP 프로젝트에서 고정 IP를 생성하여 인스턴스에 할당을 해주었다.그래서 외부 IP로 Airflow UI에 접속하여 ETL 운영 작업을 했었는데갑자기 보안 정책으로 인하여,,,,,,,,,,,,,,,,,,,,,,,,,,,,,,고정 IP를 제거하라는 요청이 들어왔다. SSH 터널링을 이용해서 외부 IP 없이 내부 IP로 Airflow UI에 접속할 수 있다. 로컬 머신에서 GCP의 VM 인스턴스에 SSH로 연결한 후, Airflow UI에 접근할 수 있도록 포트를 포워딩 0. 사전 작업 (gcloud 설치)gcloud sdk를 이용하여 로컬 기기에 ssh 연결을 해주어야 하기 때문에 gcloud cli를 입력할 수 있는 gcloud를 설치해야한다. 다음 링크를 들어가서 설치를 해준다.https://clo..